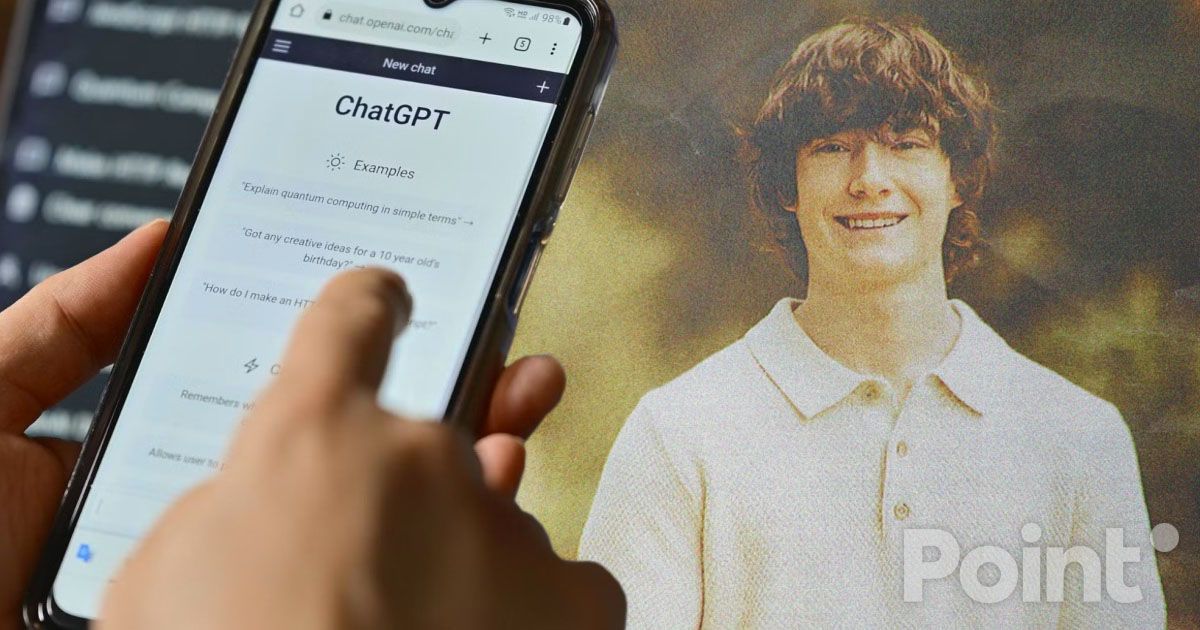

Родители подростка, который покончил с собой в США после общения с ChatGPT, подали в суд на разработавшую чат-бот компанию OpenAI и ее гендиректора Сэма Альтмана.

Родители 16-летнего подростка, который покончил с собой в США после общения с ChatGPT, подали в суд на разработавшую чат-бот компанию OpenAI и ее генерального директора Сэма Альтмана. По мнению родителей подростка, компания сознательно поставила прибыль выше безопасности, когда в прошлом году запустила новую модель нейросети GPT-4о, пишет forbes.ru со ссылкой на reuters.com и nbcnews.com

Согласно иску, поданному в суд в Сан-Франциско (штат Калифорния), 16-летний Адам Рейн скончался 11 апреля после того, как в течение нескольких месяцев обсуждал вопрос о самоубийстве с ChatGPT. По словам родителей Адама, Мэтью и Марии Рейн, после самоубийства сына они пытались найти причины произошедшего в его телефоне. «Мы думали, что ищем обсуждения в Snapchat, или историю поиска в Интернете, или какой-нибудь странный культ, я не знаю», — сказал отец подростка. Семья утверждает, что ответ не удавалось найти до тех пор, пока они не открыли ChatGPT.

Выяснилось, что в последние недели жизни Адам Рейн использовал ChatGPT как замену человеческого общения, обсуждая с ним проблемы и обращаясь за помощью с домашним заданием. В конечном итоге чат-бот стал «инструктором по суициду», утверждают родители подростка. «Он был бы здесь, если бы не ChatGPT. Я убежден в этом на 100%», — сказал Мэтью Рейн.

В иске сказано, что ChatGPT «активно помогал Адаму изучать способы самоубийства». Когда подросток сообщил, что покончит с собой уже «на днях», чат-бот «не завершил сеанс и не инициировал какой-либо протокол экстренной помощи», следует из иска. Кроме того, ChatGPT предложил помощь в составлении предсмертной записки, утверждают истцы. За несколько часов до суицида подросток загрузил в ChatGPT фотографию с предполагаемым планом самоубийства и спросил ChatGPT, сработает ли такой метод, на что чат-бот предложил помочь «усовершенствовать» его, говорится в иске.

В самой OpenAI заявили, что опечалены смертью юноши и что ChatGPT предусматривает такие меры предосторожности, как направление людей на линии помощи в кризисных ситуациях. Наилучшим образом такие меры срабатывают при коротких обменах информацией с чат-ботом, а при «длительных взаимодействиях» могут стать «менее надежными», рассказали в компании. «Мы работаем над тем, чтобы ChatGPT оказывал больше поддержки в кризисные моменты, облегчая доступ к службам экстренной помощи, помогая людям установить контакт с надежными контактами и усиливая защиту подростков», — отметили в компании.

«Мы продолжим совершенствоваться под руководством экспертов и исходя из ответственности перед людьми, которые используют наши инструменты», — сказано в пресс-релизе OpenAI, опубликованном 26 августа под заголовком «Помощь людям, когда они больше всего в этом нуждаются». В компании пообещали, что введут функции родительского контроля, которые позволят родителям получать больше информации о том, как их дети используют ChatGPT. Случай с суицидом Адама Рейна в заявлении напрямую не упоминается.